در این سالها که حسابی تبوتاب هوش مصنوعی به اوج خودش رسیده، لابهلای اخبار حرفهای ضد و نقیض در رابطه با دستاوردهای هوش مصنوعی حرفهای عجبی میشنویم. مثلا در جایی گفته میشه که هوش مصنوعی مایکروسافت نژاد پرست شده، یا یک دیدگاه سیاسی رادیکال را ترویج داده، یا مثلا در رابطه با فلان مساله اظهار نظر کرده و گفته که حضور انسان در کره زمین یک مساله زائد هست.

این دست صحبتها بیشتر یادآور مدلهای نگارش داستان به خصوص مبحث جانبخشی به اشیا هست و ارتباطی به چیزی که در واقعیت رخ میده نداره. برای اینکه به یک دیدگاه مشترک در رابطه با واقعیت هوش مصنوعی برسیم اجازه بدید کمی عمیقتر مساله رو بررسی کنیم و ببینیم داستان از چه قراره و این دیدگاههای رادیکال هوش مصنوعی دقیقا از کجا نشات گرفته.

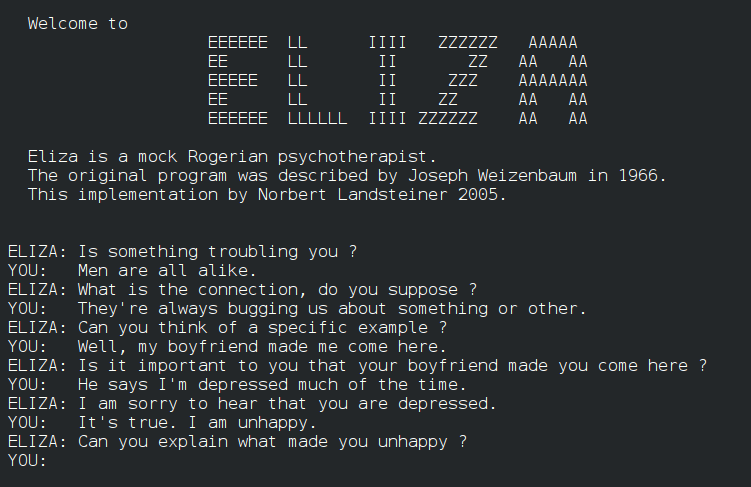

تصویری از چت بات الیزا

داستان از اینجا شروع میشه که این قبیل اظهارنظرها عمدتا توسط چتباتها منتشر میشه. این چتبات ها سالهاست که متولد شدن و در طول این سالها هرروز بهتر و بهتر شدن. لازمه بدونید که یک عمر طولانی دارن و این عمر بسیار بیشتر از چیزیه که در تصور ماست. شاید اولین برخورد ما با چت بات در حقیقت اولین باری بود که به چت جی پی تی سلام کردیم و حالشو پرسیدیم که خب این داستان مربوط به سال 2022 میلادی هست. اما جالبه بدونید که چت بات برای اولین بار در سال 1965 در آزمایشگاه تحقیقاتی انستیتو نیوجرسی با نام چت بات الیزا متولد شد. این نسخه اولیه کارایی زیادی نداشت اما عملکردش در اون زمان قابل قبول بود.

در حقیقت ما انسانها از روزی که ماشین رو اختراع کردیم یک تصور ذهنی داشتیم نسبت به اینکه این ماشینها یه روز زنده میشن یا دوستمون خواهند بود و یا بزرگترین دشمن ما میشن. یه عده از آدمهای رویاپردازی خیال بافی رو کنار گذاشتن و تلاش کردن این مساله رو به واقعیت تبدیل کنن.

پس به این ترتیب اولین تلاشها به تولد اولین چتبات نرمافزاری خطم شد که قرار بود یک دستیار روانشناسی باشه و با افراد صحبت کنه و از اونها سوالاتی رو بپرسه. طبق انتظارمون، اولین افرادی که با این چت بات شروع به صحبت کردن، سعی میکردن نشانههای خودآگاهی رو در صحبتهاش پیدا کنن، دقیقا چیزی که گاهی سراغ ماهم میاد. به طور پیش فرض هربار که سراغ یک هوش مصنوعی جدید میریم، سعی میکنیم با سوالای مختلف میزان خودآگاهی اون رو بسنجیم یا نظرشو راجع به مسائلی که ذاتا درکی ازشون نداره رو جویا بشیم.

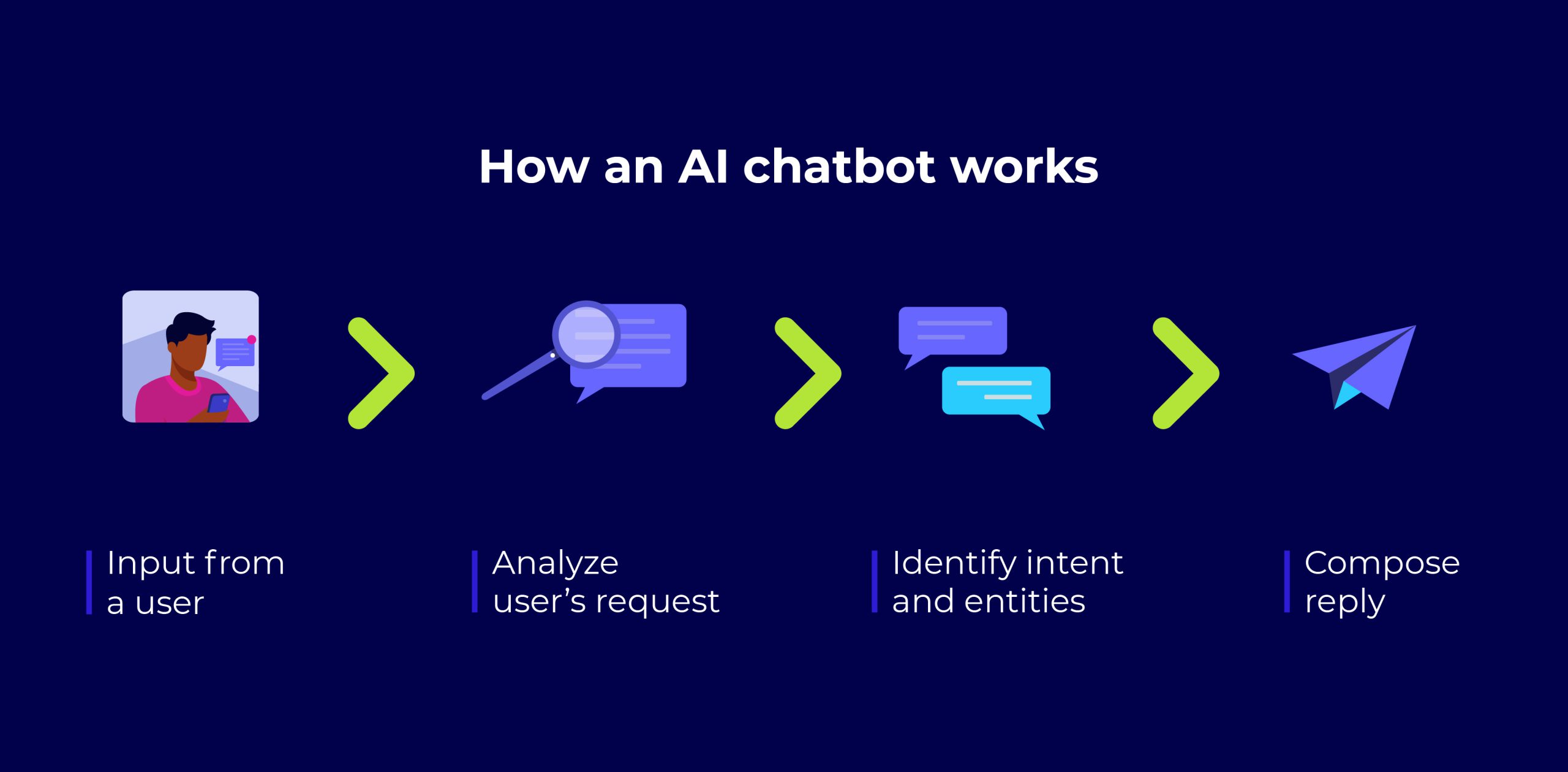

برگردیم سراغ داستان اصلی و ببینیم زیر پوست چت باتها چه خبره و دقیقا چطور کار می کنن. این عقایدشون از کجا میاد و موجود مصنوعی که مقابل ماست دقیقا چطور فکر می کنه و حرف میزنه.

اینجا قصد ندارم مباحث فنی و محاسباتی پیچیده ای که پشت یک چتبات اتفاق میافته رو تشریح کنم، چون قطعا از حوصله خارجه اما به شکل نمادین با بررسی یک سری تصاویر سعی میکنیم عملکردش رو درک کنیم.

برای تحلیل عملکرد یک چتبات هوش مصنوعی باید دوتا سوال مهم رو پاسخ بدیم. اول اینکه چت بات ها چطور یاد میگیرند و دوم اینکه چتباتها چطور چیزهایی که یاد گرفتند رو بیان میکنن.

چتباتها چطور یاد میگیرند؟

احتمالا پاسخ این سوال رو قبلا بارها و بارها در منابع مختلف شنیدید. هوش مصنوعی با مطالعه حجم انبوهی از اطلاعات چیزهای مختلف رو یاد میگیره، پس چتباتها به عنوان یک شاخه مهم از هوش مصنوعی با مطالعه حجم انبوهی از متنها که شامل مقالات، گفتگوهای متنی موجود در وب و کتاب و به طور کلی هر نوع متن دیجیتالی که در اختیارش قرار میگیره، چیزهای مختلف رو یاد میگیره.

تا اینجای داستان رو همه شنیدیم، اما مساله اینجاست که این یادگیری دقیقا چطور اتفاق میفته؟

بزارید از یک مثال خیلی آشنا شروع کنیم، زمانی که دارید در موبایل یک پیام تایپ می کنید احتمالا متوجه یه بخش خاص از کیبرد شدید که بلافاصله وقتی یک کلمه رو مینویسید، کلمه بعدی رو پیشنهاد میده، یا حتی وقتی هنوز دو حرف اول یک کلمه رو نوشتید، کلمه بعدی رو بهتون پیشنهاد میده. دقیقا این کاری که در موبایل شما اتفاق میافته یک نوع هوش مصنوعیه!

این شکل از هوش مصنوعی که مدل سنتی یا کلاسیک به حساب میاد، در حقیقت با مطالعه حجم انبوهی از متنها، کلمه به کلمه یاد میگیره و تقریبا با دقت نسبتا بالایی میتونه پیشبینی کنه که بعد از هر کلمه چه کلمه دیگهای باید بیاد. مثلا در هزاران متنی که در فرآیند یادگیری خونده متوجه شده که بعد از کلمه “خوش” به احتمال بسیار بالا کلمه “بگذره” به کار میره که میشه «خوش بگذره». دقیقا مدل محاسباتی این مدلهای کلاسیک بر مبنای احتمالات پیش میره.

این شکل از پردازش صرفا مربوط به مدلهای کلاسیک نیست و مدلهای جدیدتر هم عملکرد مشابهی دارن. مدلهای زبانی بزرگ مثل چیزی که در پس زمینه Chat GPT قرار گرفته با استفاده از مدلهای احتمالاتی ساخته نشده اما از نظر عملکردی به طور دائم در حال پیشبینی کلمات، ترکیبها و در نهایت جملاتی هست که قراره در اختیار شما قرار بده. پس تا اینجای کار میدونیم که یک چت بات هوش مصنوعی با مطالعه حجم انبوهی از اطلاعات فهمیده که بعد از درج هر کلمه ممکنه چه کلمه دیگهای بیاد، چون میلیونها بار اون کلمه رو در متون مختلف دیده و در اکثر دفعات بعد از اون یک یا چند کلمه خاص رو دیده.

این داستان در مقیاس بزرگتر هم تکرار میشه. تصور کنید سوالی رو از یک چت بات میپرسید، مدل هوش مصنوعی که در پشت چتبات پنهان شده یا همون مغز مصنوعی، تلاش میکنه نمونههای مشابه رو ارزیابی کنه و ببینه براساس چیزهایی که قبلا دیده دقیقا چه پاسخی باید برای شما ارائه کنه.

حالا احتمالا پاسخ سوال دوم رو هم می دونید؛ اینکه چتباتها چطور چیزهایی که یاد گرفتند رو بیان می کنند.

وقتشه برگردیم سراغ سوال عنوان اصلی این مطلب؛ عقاید هوش مصنوعی، عقاید ماست.

وقتی افراد زیادی در اینترنت با دیدگاه نژادپرستانه حرفهایی رو مطرح کردند، پس یک مدل هوش مصنوعی با مطالعه اون صحبتها قطعا نژادپرست خواهد شد. البته اینجا لازمه به این نکته توجه کنید که مدلهای فعلی درک کاملی از حرفهایی که بیان میکنند ندارند. در حقیقت صرفا چیزی که یاد گرفتن رو بیان میکنن و اون مباحثی که یادگرفتن ممکنه اشتباه باشه.

به همین دلیل هست که میگیم دیدگاه هوش مصنوعی نسبت به خیلی از مسائل پوچ و بیاهمیته و در حقیقت دیدگاه ماست که در قالب انبوهی از دادهها بهش دیکته شده و اون تکرار میکنه.

نظرات کاربران